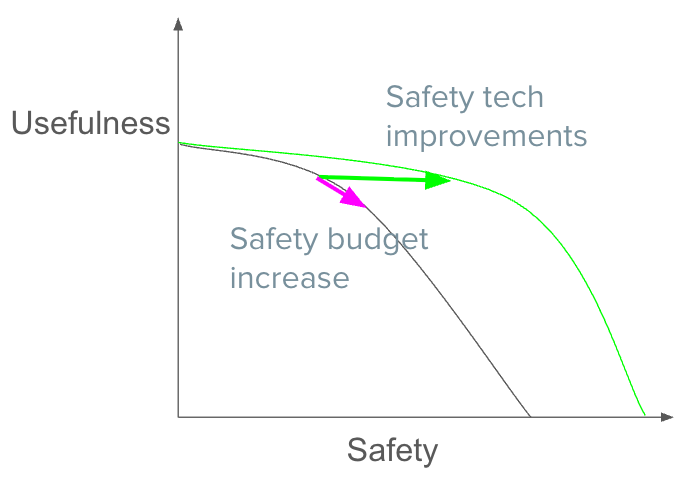

有效权衡和安全性-有用性权衡模型

I often use what Ill call the safetyusefulness tradeoff model, which is developers face a tradeoff between safety and usefulness of an AI deployment, and the developer has only limited willingness or ability to sacrifice usefulness for the sake of safety。Throughout this post, Ill use you to refer to...